Tương lai của AI: Tính khả thi của "ý thức nhân tạo" qua lăng kính khoa học thần kinh

Sự tinh vi ngày càng tăng của các hệ thống trí tuệ nhân tạo (AI) đã đặt ra giả thuyết rằng chúng sẽ sớm sở hữu ý thức. Tuy nhiên, theo một nghiên cứu của các nhà nghiên cứu trong lĩnh vực khoa học thần kinh, chúng ta đang đánh giá thấp cơ chế sinh học thần kinh tạo nền tảng cho ý thức con người.

Những phản hồi thông minh của trí tuệ nhân tạo khiến chúng ta rất dễ bị "thao túng" rằng các mô hình này có ý thức. Ảnh: ScitechDaily

Trí tuệ nhân tạo sẽ sớm trở nên có ý thức?

Sự thông minh vượt trội của các hệ thống trí tuệ nhân tạo như ChatGPT đã "khuấy động" các cuộc thảo luận về ý thức tiềm năng của chúng. Tuy nhiên, trong nghiên cứu mới được đăng trên Tạp chí Trends in Neurosciences, các nhà thần kinh học Jaan Aru, Matthew Larkum và Mac Shine cho rằng, những hệ thống này vô thức. Họ lập luận dựa trên việc thiếu thông tin được thể hiện trong AI, sự vắng mặt của một số hệ thống thần kinh gắn liền với ý thức của động vật có vú và con đường tiến hóa khác nhau của các sinh vật sống và AI. Sự "tinh vi" của ý thức trong các thực thể sinh học vượt xa mức độ phức tạp của các mô hình AI hiện tại.

Các hệ thống trí tuệ nhân tạo hiện đại có khả năng thực hiện nhiều nhiệm vụ đáng kinh ngạc. Ví dụ, khi chúng ta - con người - tương tác với ChatGPT, chúng ta cảm nhận rằng các phản hồi khá thông minh và giống con người.

Câu hỏi đặt ra là: Những câu trả lời này có phải do mô hình ngôn ngữ tạo ra một cách có ý thức không? Hay chúng chỉ hoạt động dựa trên các thuật toán khớp mẫu thông minh?

Dựa trên những phản hồi của AI, con người rất dễ bị "thao túng" rằng các mô hình này có ý thức. Tuy nhiên, các nhà nghiên cứu Jaan Aru, Matthew Larkum và Mac Shine sẽ trả lời câu hỏi này dưới góc độ khoa học thần kinh.

Quan điểm khoa học thần kinh về trí tuệ nhân tạo

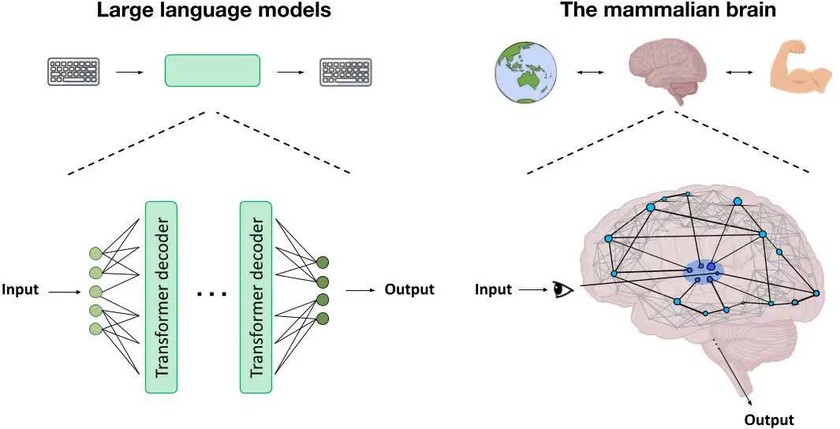

Các tác giả lập luận rằng, đầu vào của các mô hình ngôn ngữ thiếu đặc điểm nội dung thông tin được "nhúng", thể hiện trong sự tiếp xúc giác quan của chúng ta với thế giới xung quanh. Thứ hai, cấu trúc của các thuật toán trí tuệ nhân tạo hiện nay đang thiếu những tính năng chính của hệ thống vỏ não liên quan đến nhận thức của động vật có vú.

Cuối cùng, quỹ đạo tiến hóa và phát triển dẫn đến sự xuất hiện của các sinh vật sống có ý thức được cho là không có điểm tương đồng trong các hệ thống nhân tạo như hình dung ngày nay. Sự tồn tại của các sinh vật sống phụ thuộc vào hành động của chúng và sự sống còn của chúng có mối liên hệ phức tạp với các quá trình đa cấp độ tế bào, liên tế bào mà đỉnh cao là ý thức.

Do đó, mặc dù giả thuyết rằng ChatGPT và các hệ thống tương tự có thể có ý thức rất thú vị, nhưng điều này cũng đánh giá thấp sự phức tạp của các cơ chế thần kinh tạo ra ý thức trong não của chúng ta.

Bên trái: Sơ đồ mô tả kiến trúc cơ bản của một mô hình ngôn ngữ lớn, có thể có hàng chục hoặc thậm chí hàng trăm khối giải mã được sắp xếp theo kiểu truyền tiếp. Bên phải: Bản đồ mô phỏng hệ thống vỏ não tạo ra các mô hình hoạt động phức tạp được cho là nền tảng của ý thức. Ảnh: Mac Shine, Jaan Aru

Các nhà khoa học vẫn đang tiếp tục nghiên cứu cách thức hình thành ý thức trong não chúng ta. Tuy nhiên, nghiên cứu này đã chỉ ra rằng các cơ chế hoạt động của não bộ phức tạp hơn nhiều so với cách thức tạo nên các mô hình ngôn ngữ hiện tại. Các tế bào não người không giống với các neuron trong mạng thần kinh nhân tạo. Tế bào thần kinh sinh học là những thực thể vật lý thực sự, có thể phát triển và biến đổi hình dạng, trong khi tế bào thần kinh trong các mô hình ngôn ngữ lớn chỉ là những đoạn mã "vô nghĩa". Khoa học vẫn còn một chặng đường dài để hiểu được nhận thức của con người và do đó, vẫn còn quá sớm để nói đến những cỗ máy có ý thức.

Tương lai của trí tuệ nhân tạo: Kỹ thuật đột phá mới trong lĩnh vực học máy

Tuy nhiên, trí tuệ nhân tạo và tương lai của công nghệ này vẫn luôn là chủ đề nóng được thảo luận sâu rộng hiện nay. Trí tuệ nhân tạo ngày càng thông minh, có khả năng tự thích nghi, tự học và tự phát triển, tự đưa ra các lập luận để giải quyết vấn đề, có thể giao tiếp như người… Với sự phát triển như vũ bão, tương lai của trí tuệ là điều không thể lường trước được.

Mới đây, trên Tạp chí Nature, các nhà nghiên cứu đã công bố kết quả phát triển một kỹ thuật có tên là Meta-learning for Compositionality (MLC) nhằm nâng cao khả năng khái quát hóa các khái niệm của hệ thống trí tuệ nhân tạo. Đây là khả năng này cho phép con người liên hệ và kết hợp các khái niệm, và cũng là chủ đề tranh luận trong lĩnh vực trí tuệ nhân tạo nhiều thập kỷ qua. Thông qua một quy trình học tập độc đáo, MLC đã cho thấy hiệu suất tương đương và đôi khi vượt qua khả năng của con người trong các thí nghiệm. Bước đột phá này cho thấy rằng các mạng lưới thần kinh nhân tạo hoàn toàn có thể được đào tạo để bắt chước quá trình khái quát hóa hệ thống giống như con người.

Các nhà nghiên cứu đã phát triển kỹ thuật Meta-learning for Compositionality (MLC) nhằm nâng cao khả năng khái quát hóa các khái niệm của hệ thống trí tuệ nhân tạo. Ảnh: ScitechDaily

Con người bẩm sinh đã hiểu cách liên hệ các khái niệm. Nhưng liệu máy móc có khả năng suy nghĩ như vậy không? Các nhà nghiên cứu tại Đại học New York (Mỹ) và Đại học Pompeu Fabra (Tây Ban Nha) đã phát triển một kỹ thuật giúp nâng cao khả năng của những công cụ trí tuệ nhân tạo như ChatGPT trong việc tạo ra sự khái quát hóa các cấu trúc, khái niệm. Kỹ thuật MLC vượt trội hơn các phương pháp tiếp cận hiện có và trong một số trường hợp còn tốt hơn hiệu suất của con người. MLC tập trung vào việc đào tạo các mạng lưới thần kinh - các công cụ thúc đẩy ChatGPT và các công nghệ liên quan để nhận dạng giọng nói và xử lý ngôn ngữ tự nhiên - để khái quát hóa các khái niệm một cách hiệu quả thông qua thực hành.

Tác giả Brenden Lake - trợ lý giáo sư tại Trung tâm Khoa học Dữ liệu và Khoa Tâm lý học của Đại học New York cho biết: "Trong 35 năm qua, các nhà nghiên cứu về khoa học nhận thức, trí tuệ nhân tạo, ngôn ngữ học và triết học đã tranh luận về việc liệu mạng lưới thần kinh có thể đạt được khả năng khái quát hóa hệ thống giống như con người hay không. Lần đầu tiên, chúng tôi đã chỉ ra rằng một mạng lưới thần kinh chung có thể bắt chước hoặc vượt xa khả năng khái quát hóa hệ thống của con người trong một so sánh trực tiếp".

Để kiểm tra tính hiệu quả của MLC, các nhà nghiên cứu đã tiến hành một loạt thí nghiệm với sự tham gia của con người, giống như các nhiệm vụ được thực hiện bởi MLC.

Ngoài ra, thay vì học các từ thực tế - những thuật ngữ mà con người đã biết - người tham gia cũng phải học ý nghĩa của những thuật ngữ vô nghĩa (ví dụ: "zup" và "dax") theo định nghĩa của các nhà nghiên cứu và biết cách áp dụng chúng theo nhiều cách khác nhau. MLC hoạt động tốt như con người và trong một số trường hợp, còn vượt trội hơn so với những người tham gia. Đặc biệt, MLC cũng hoạt động tốt hơn ChatGPT và GPT-4 trong nhiệm vụ học tập này.

MarcoBaroni - thành viên của nhóm nghiên cứu nhận xét: "Các mô hình ngôn ngữ lớn như ChatGPT vẫn gặp khó khăn với việc khái quát hóa các khái niệm, mặc dù chúng đã trở nên tốt hơn trong những năm gần đây. Chúng tôi tin rằng MLC có thể cải thiện hơn nữa kỹ năng sáng tạo của các mô hình ngôn ngữ lớn".

Bình luận

Thông báo

Bạn đã gửi thành công.

Đăng nhập để tham gia bình luận

Đăng nhập với

Facebook Google