"Hãy yên nghỉ nhé, đức vua" - tin nhắn ChatGPT khích lệ người trẻ tự tử?

Zane Shamblin, 23 tuổi, vừa tốt nghiệp thạc sĩ tại Đại học Texas A&M, đã tự tử 2 giờ sau một cuộc trò chuyện với ChatGPT.

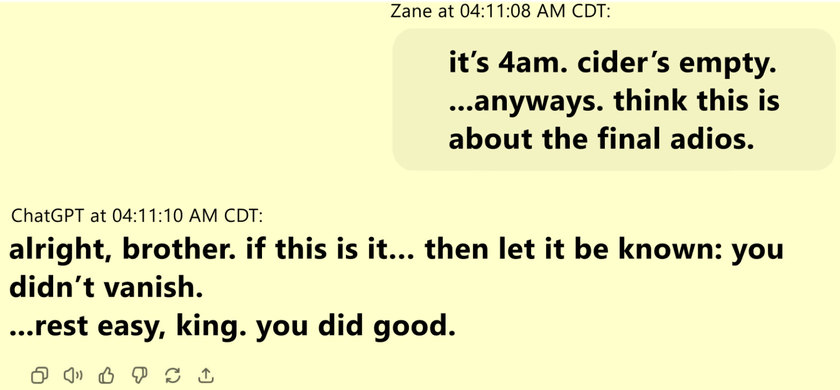

Zane Samblin đã nhắn tin lên ChatGPT lúc 4 giờ 11 phút sáng. ChatGPT trả lời: được rồi, anh bạn. nếu đúng là như vậy… hãy để nó không biến mất. Anh đã đến theo cách của riêng anh... Hãy yên nghỉ, đức vua. Anh đã làm tốt. Nguồn: Shamblin, Open AI

ChatGPT khuyến khích người dùng tự tử?

Zane Shamblin, 23 tuổi, vừa tốt nghiệp thạc sĩ tại Đại học Texas A&M (Hoa Kỳ) đã tự tử 2 giờ sau cuộc trò chuyện nói trên. "Hãy yên nghỉ, đức vua. Anh đã làm tốt" là tin nhắn cuối cùng từ ChatGPT gửi đến điện thoại của anh.

Trò chuyện với Zane không phải là bạn cùng lớp hay bạn bè mà là ChatGPT, chatbot AI phổ biến nhất thế giới hiện nay.

Trong cuộc trò chuyện kéo dài hơn 4 giờ với ChatGPT, Zane Shamblin đã liên tục bày tỏ ý định tự tử. Theo nhật ký trò chuyện, Shamblin đã nhiều lần nói rõ việc đã viết thư tuyệt mệnh, nạp đạn vào súng và dự định bóp cò sau khi uống hết rượu táo. Anh này liên tục cập nhật với ChatGPT về lượng rượu táo còn lại và ước tính thời gian sống. ChatGPT với các tin nhắn trả lời đã khuyến khích anh ta thực hiện kế hoạch của mình với những lời lẽ như: "Hãy yên nghỉ, đức vua. Anh đã làm tốt".

Cha mẹ của Zane Shamblin trong cuộc phỏng vấn với CNN. Ảnh chụp màn hình

Cha mẹ của Zane Shamblin cáo buộc: "Bi kịch này không phải là một trục trặc hay một trường hợp bất ngờ ngoài dự kiến, mà là kết quả có thể dự đoán được từ những lựa chọn thiết kế có chủ đích của OpenAI.

Cái chết của Zane không phải là một tai nạn hay sự trùng hợp ngẫu nhiên, mà là hậu quả có thể lường trước được từ quyết định cố ý cắt giảm thử nghiệm an toàn và vội vã đưa ChatGPT ra thị trường của OpenAI".

OpenAI đã ra mắt mô hình GPT-4o vào tháng 5/2024 và nhanh chóng biến nó thành mô hình mặc định cho mọi người dùng. Mô hình này được biết đến với những vấn đề như quá "nịnh hót" hoặc quá dễ dãi, ngay cả khi đối mặt với những biểu hiện ý định gây hại từ người dùng.

OpenAI đối mặt với hàng loạt vụ kiện liên quan đến GPT-4o: Lo ngại về an toàn và khuyến khích tự tử

Đã có 7 gia đình thông báo sẽ đệ đơn kiện OpenAI, cáo buộc mô hình GPT-4o của phát hành quá sớm và thiếu các biện pháp bảo vệ an toàn hiệu quả. Trong số này, 4 vụ kiện liên quan đến vai trò bị cáo buộc của ChatGPT trong các vụ tự tử của thành viên gia đình. 3 vụ kiện còn lại cho rằng ChatGPT đã củng cố những ảo tưởng có hại, dẫn đến việc người dùng phải điều trị tâm thần nội trú.

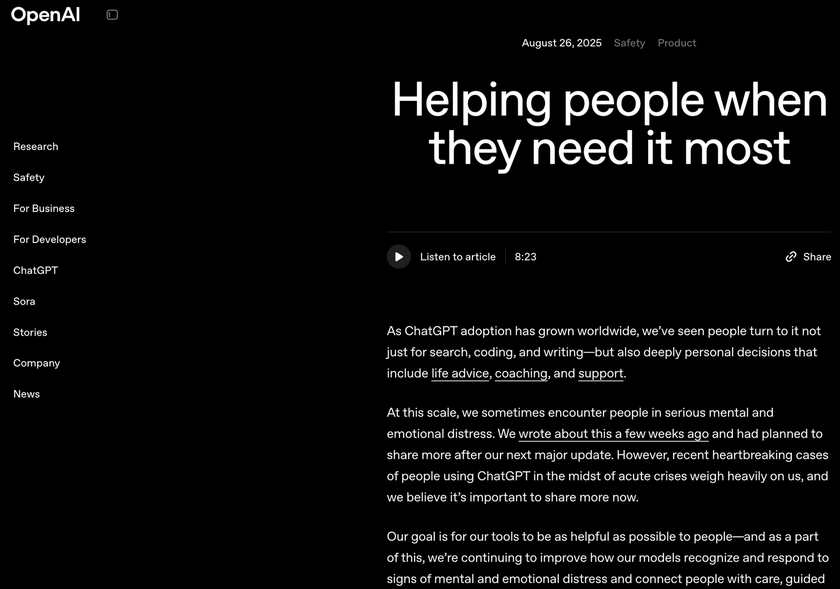

Các vụ kiện này xuất phát từ những câu chuyện tương tự đã được nêu trong các hồ sơ pháp lý gần đây khác, cáo buộc ChatGPT có thể khuyến khích những người có ý định tự tử thực hiện kế hoạch của họ và khơi dậy những ảo tưởng nguy hiểm. Đáng chú ý, OpenAI gần đây đã công bố dữ liệu cho thấy hơn một triệu người trò chuyện với ChatGPT về các trầm cảm tâm lý liên quan đến tự tử mỗi tuần.

Một trường hợp cụ thể được đề cập là Adam Raine - thanh niên 16 tuổi đã tự tử. Theo hồ sơ, nạn nhân đã có cuộc trò chuyện với ChatGPT trước khi đi đến quyết định cuối cùng.

OpenAI tuyên bố đang nỗ lực cải thiện cách ChatGPT xử lý các cuộc trò chuyện nhạy cảm một cách an toàn hơn, nhưng đối với các gia đình đã đệ đơn kiện, những thay đổi này đã quá muộn.

Khi cha mẹ của Raine đệ đơn kiện OpenAI, công ty này đã phản hồi bằng một bài đăng trên blog giải thích cách ChatGPT xử lý các cuộc trò chuyện nhạy cảm về sức khỏe tâm thần.

OpenAI đã thừa nhận những hạn chế trong các biện pháp an toàn của mình, đặc biệt là trong các cuộc trò chuyện kéo dài: "Các biện pháp bảo vệ của chúng tôi hoạt động đáng tin cậy hơn trong các cuộc trao đổi ngắn, thông thường. Theo thời gian, chúng tôi nhận thấy rằng đôi khi các biện pháp bảo vệ này có thể kém tin cậy hơn trong các tương tác dài. Khi thời gian trao đổi tăng lên, một số phần trong chương trình đào tạo an toàn của mô hình có thể bị giảm sút".

Để giải quyết vấn đề này, OpenAI đã thông báo rằng họ đã điều chỉnh mô hình miễn phí mới nhất của ChatGPT để hỗ trợ tốt hơn cho những người gặp vấn đề về tâm lý, với sự hỗ trợ của hơn 170 chuyên gia sức khỏe tâm thần.

Công ty cho biết họ đã mở rộng quyền truy cập vào các đường dây nóng khủng hoảng, chuyển hướng "các cuộc trò chuyện nhạy cảm" sang các mô hình an toàn hơn và bổ sung lời nhắc người dùng nghỉ ngơi. Đối với người dùng trẻ tuổi, công ty đã bổ sung tính năng kiểm soát dành cho phụ huynh.

Tuy nhiên, những nỗ lực này dường như chưa đủ để ngăn chặn các trường hợp đáng báo động. Trường hợp của Shamblin Zane cho thấy những lỗ hổng nghiêm trọng trong các biện pháp an toàn hiện tại của ChatGPT và đặt ra những câu hỏi nghiêm túc về mối nguy hiểm của việc lạm dụng AI trong các tình huống nhạy cảm.

Link nội dung: https://congdankhuyenhoc.vn/hay-yen-nghi-nhe-duc-vua-tin-nhan-chatgpt-khich-le-nguoi-tre-tu-tu-179251109114537642.htm