ChatGPT Health: AI có thể thay thế bác sĩ và chiếm lấy lòng tin người dùng?

Sự ra đời của ChatGPT Health đánh dấu một bước tiến lớn của AI y tế, nhưng cũng đồng thời mở ra một câu hỏi không thể né tránh: Khi máy móc trở thành người “đối thoại” về sức khỏe, đâu là ranh giới giữa hỗ trợ thông tin và thay thế niềm tin y khoa?

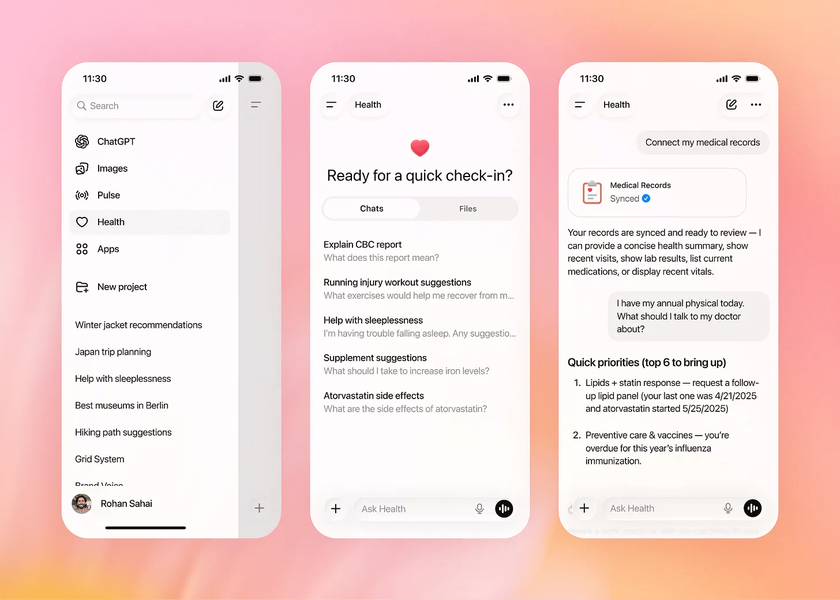

Nguồn: Open AI

Ngày 7/1/2026, OpenAI chính thức ra mắt ChatGPT Health, đánh dấu một bước ngoặt quan trọng của trí tuệ nhân tạo trong lĩnh vực y tế số. Đây không đơn thuần là một bản cập nhật tính năng, mà là việc mở ra một không gian chuyên biệt, tách biệt hoàn toàn khỏi các cuộc hội thoại thông thường, nơi người dùng có thể trao đổi sâu về tình trạng sức khỏe và thể chất cá nhân.

Sự kiện này diễn ra trong bối cảnh hơn 230 triệu người mỗi tuần đang tìm đến ChatGPT để hỏi về các vấn đề y tế - một con số cho thấy AI đã sớm trở thành "điểm chạm y tế" đầu tiên của hàng trăm triệu người trên toàn cầu.

ChatGPT Health vì thế xuất hiện như lời hứa về một giải pháp cho cơn khát thông tin y khoa đang vượt xa khả năng đáp ứng của các hệ thống y tế truyền thống.

Tuy nhiên, khi AI bắt đầu tiếp cận những dữ liệu sức khỏe nhạy cảm nhất của con người, một câu hỏi không thể né tránh được đặt ra: Liệu chúng ta đang trao niềm tin y tế cho một công cụ hỗ trợ, hay từng bước chuyển giao nó cho một thuật toán?

ChatGPT Health và lời hứa về một "bác sĩ túi áo"

OpenAI định vị ChatGPT Health như một phản ứng trực diện trước những hạn chế kéo dài của chăm sóc y tế hiện nay: chi phí cao, khả năng tiếp cận không đồng đều, hệ thống quá tải và sự gián đoạn trong theo dõi sức khỏe cá nhân.

Điểm đột phá lớn nhất của công cụ này nằm ở khả năng kết nối dữ liệu sức khỏe đa nguồn. Người dùng có thể đồng bộ hóa ChatGPT Health với các nền tảng theo dõi phổ biến để phân tích giấc ngủ, vận động, dinh dưỡng, cũng như tích hợp kết quả xét nghiệm nhằm cung cấp những diễn giải cá nhân hóa hơn. Thay vì đối mặt với các chỉ số khô khan, người dùng được "dịch" dữ liệu y tế sang ngôn ngữ dễ hiểu.

Để chuẩn bị cho bước đi này, OpenAI cho biết đã mất hai năm làm việc cùng hàng trăm bác sĩ thuộc nhiều chuyên khoa nhằm định hình cách AI phản hồi, đặc biệt trong việc nhận diện mức độ khẩn cấp, hướng người dùng đến cơ sở y tế khi cần thiết và ưu tiên an toàn trong các tình huống liên quan đến sức khỏe tâm thần.

Ở bề mặt, ChatGPT Health giống như một "trợ lý y tế cá nhân" luôn sẵn sàng, không mệt mỏi, không rào cản địa lý và có khả năng xử lý lượng thông tin mà trước đây chỉ bác sĩ mới tiếp cận được. Nhưng chính sự tiện lợi đó lại làm mờ đi một ranh giới quan trọng: AI đang hỗ trợ bác sĩ, hay đang thay thế vai trò trung gian niềm tin giữa bác sĩ và bệnh nhân?

Robot và AI ngày càng hữu ích trong chăm sóc y tế. Hình ảnh: kr-asia.

"Tường lửa" quyền riêng tư: Khi bảo mật chưa đồng nghĩa với bảo vệ pháp lý

Nhận thức được mức độ nhạy cảm của dữ liệu y tế, OpenAI tuyên bố đã xây dựng một hệ thống bảo mật nhiều lớp cho ChatGPT Health. Các cuộc trò chuyện được cách ly hoàn toàn, không xuất hiện trong các luồng hội thoại khác và không được sử dụng để huấn luyện mô hình nền tảng. Người dùng có quyền xem, chỉnh sửa hoặc xóa dữ liệu y tế bất cứ lúc nào.

Tuy nhiên, giữa bảo mật kỹ thuật và bảo vệ pháp lý vẫn tồn tại một khoảng trống đáng lo ngại. ChatGPT Health hoạt động ngoài khuôn khổ các chuẩn bảo mật y tế truyền thống, đồng nghĩa với việc người dùng không được hưởng các cơ chế bảo vệ pháp lý nghiêm ngặt như khi làm việc trực tiếp với bác sĩ hay cơ sở y tế.

Nói cách khác, mối quan hệ giữa người dùng và ChatGPT Health vẫn là một "quan hệ hợp đồng với công ty công nghệ", không phải quan hệ chăm sóc y khoa có trách nhiệm nghề nghiệp ràng buộc. Trong trường hợp xảy ra rủi ro, người dùng có rất ít công cụ pháp lý để bảo vệ quyền lợi của mình.

Vấn đề đạo đức: AI "trả lời trôi chảy" nhưng không biết đúng - sai

Cốt lõi của rủi ro đạo đức nằm ở bản chất kỹ thuật của AI. ChatGPT không "hiểu" sự thật y khoa theo nghĩa con người, mà vận hành bằng cách dự đoán chuỗi ngôn ngữ có xác suất cao nhất. Điều này dẫn đến hiện tượng "ảo giác AI" - nơi các kết luận sai lệch được trình bày một cách logic và thuyết phục.

Trong y học, nơi một sai lệch nhỏ có thể dẫn đến hậu quả nghiêm trọng, việc AI luôn cố gắng đưa ra câu trả lời ngay cả khi không chắc chắn là một rủi ro lớn. Khi dữ liệu đầu vào không đầy đủ, bị phân mảnh hoặc mang định kiến lịch sử, AI có thể "điền vào chỗ trống" bằng suy đoán thuật toán, từ đó tạo ra các khuyến nghị không đáng tin cậy.

Nguyên tắc nền tảng của y học với lời thề Hippocrates "trước hết, đừng gây hại" (Do not harm) không phải là một dòng mã có thể lập trình sẵn. Nó đòi hỏi phán đoán, trách nhiệm đạo đức và khả năng cân nhắc bối cảnh xã hội mà AI hiện nay chưa thể tự thân đáp ứng.

Ngay cả những chuyên gia ủng hộ AI y tế cũng thừa nhận: ChatGPT Health chỉ an toàn khi được sử dụng trong "khung niềm tin có điều kiện".

AI không nên và không thể thay thế bác sĩ trong chẩn đoán hay điều trị. Vai trò phù hợp nhất của ChatGPT Health nằm ở các lĩnh vực ít rủi ro hơn như hỗ trợ lối sống lành mạnh, phân tích dữ liệu sức khỏe cá nhân, hoặc giúp người dùng chuẩn bị câu hỏi trước khi gặp bác sĩ.

Quan trọng hơn, mọi khuyến nghị của AI phải luôn được đặt dưới sự giám sát của con người. Khi người dùng bắt đầu coi AI là "thẩm quyền y tế", ranh giới giữa hỗ trợ thông tin và quyết định sinh mệnh sẽ bị xóa nhòa và đó là lúc rủi ro trở nên hệ thống.

ChatGPT Health mở ra một giai đoạn mới, nơi mỗi cá nhân có thể tiếp cận một trợ lý số hỗ trợ quản lý thông tin sức khỏe hằng ngày. Tuy nhiên, cần khẳng định rõ: AI không phải là bác sĩ và càng không thể trở thành chuẩn mực đạo đức của y khoa. Trí tuệ nhân tạo, dù mạnh mẽ đến đâu, vẫn chỉ là công cụ vận hành trên dữ liệu và thuật toán: không có lương tâm, không chịu trách nhiệm pháp lý và không thể thay thế phán đoán chuyên môn của con người.

Niềm tin của người dùng đối với các ứng dụng AI trong y tế vì thế không thể là một phép thử trao trọn cho công nghệ. Đó phải là niềm tin có điều kiện, được xây dựng trên sự hiểu biết đầy đủ về giới hạn của thuật toán, về khả năng sai lệch của dữ liệu đầu vào, cũng như về vai trò không thể thay thế của bác sĩ trong chẩn đoán và điều trị.

Việc sử dụng AI trong chăm sóc sức khỏe nếu thiếu sự dẫn dắt chuyên môn từ đội ngũ y tế và thiếu sự cảnh giác chủ động của người dùng có thể dẫn đến những rủi ro nghiêm trọng, từ hiểu sai thông tin bệnh lý đến trì hoãn điều trị, với hậu quả khó lường đối với sức khỏe và tính mạng.

Sự ra đời của ChatGPT Health vì vậy nên được nhìn nhận như một bước tiến công nghệ quan trọng, nhưng không phải là "vị thánh y" sở hữu tri thức tuyệt đối. Đó là một công cụ hỗ trợ đầy tiềm năng, song vẫn tồn tại những khiếm khuyết căn bản về độ chính xác, trách nhiệm và đạo đức.

Cách xã hội lựa chọn đặt niềm tin vào AI: tỉnh táo hay mù quáng sẽ quyết định liệu công nghệ này trở thành trợ thủ của y học hay một rủi ro mới trong hệ thống chăm sóc sức khỏe hiện đại.

Xây dựng niềm tin vào AI có trách nhiệm trong lĩnh vực y tế tại Việt Nam

Tại Việt Nam, việc ứng dụng trí tuệ nhân tạo trong y tế đang được nhìn nhận không chỉ như một bước tiến công nghệ, mà là một bài toán quản trị niềm tin xã hội. Các chuyên gia cảnh báo rằng, nếu thiếu khung đạo đức và trách nhiệm giải trình rõ ràng, AI có thể làm gia tăng rủi ro thay vì cải thiện chất lượng chăm sóc sức khỏe.

Theo các phân tích chính sách, AI có tiềm năng lớn trong hỗ trợ chẩn đoán hình ảnh, tối ưu hóa quy trình khám chữa bệnh và rút ngắn thời gian phát hiện bệnh. Tuy nhiên, để công nghệ này thực sự phục vụ lợi ích công cộng, Việt Nam đang thúc đẩy cách tiếp cận AI có trách nhiệm, đặt con người và quyền lợi người bệnh làm trung tâm.

Các nguyên tắc cốt lõi được nhấn mạnh gồm:

- Minh bạch và khả năng giải thích của thuật toán y tế

- Bảo vệ quyền tự chủ và dữ liệu cá nhân của người bệnh

- Công bằng và không phân biệt đối xử trong tiếp cận dịch vụ

- Trách nhiệm giải trình rõ ràng khi AI gây ra rủi ro

- Cam kết nguyên tắc y học tối thượng: "Không gây hại"

Trên bình diện quản lý nhà nước, Việt Nam đang từng bước xây dựng khung đạo đức và quản trị AI, với sự phối hợp của các bộ, ngành liên quan, nhằm bảo đảm rằng đổi mới công nghệ đi cùng với an toàn xã hội. Trong lĩnh vực y tế, AI không được phép thay thế phán đoán chuyên môn của bác sĩ, mà chỉ đóng vai trò công cụ hỗ trợ có kiểm soát.

Cách tiếp cận này cho thấy, niềm tin vào AI y tế tại Việt Nam không được xây dựng bằng tốc độ triển khai, mà bằng năng lực quản trị, giám sát và trách nhiệm xã hội đặc biệt với những nhóm dễ tổn thương như người cao tuổi và bệnh nhân mãn tính.

Link nội dung: https://congdankhuyenhoc.vn/chatgpt-health-ai-co-the-thay-the-bac-si-va-chiem-lay-long-tin-nguoi-dung-179260113102656617.htm